使用腾讯云大模型知识引擎搭建满血deepseek

前言

· 最近deepseek的爆火导致了其官网大部分时间不可使用,很多小伙伴在官网访问的时候经常会遇到以下问题:

那么,应该如何解决这个问题,使我们可以无限制的使用deepseek呢?网络上有一些说法是将deepseek部署到本地(基本都是基于ollama),这么做不能说不行,但基本都是有损的。一般来说我们本地的配置基本上不可能带的动满血deepseek大模型,而使用阉割版的话其实效果并不一定强过现有的其他大模型。所以为了能获得最好的效果,一个可行的方向是:使用云端的资源和算力来为我们部署满血的deepseek。接下来我们以腾讯云大模型知识引擎为例来看看如何进行部署和使用。(整个流程5min以内搞定)

腾讯云大模型知识引擎

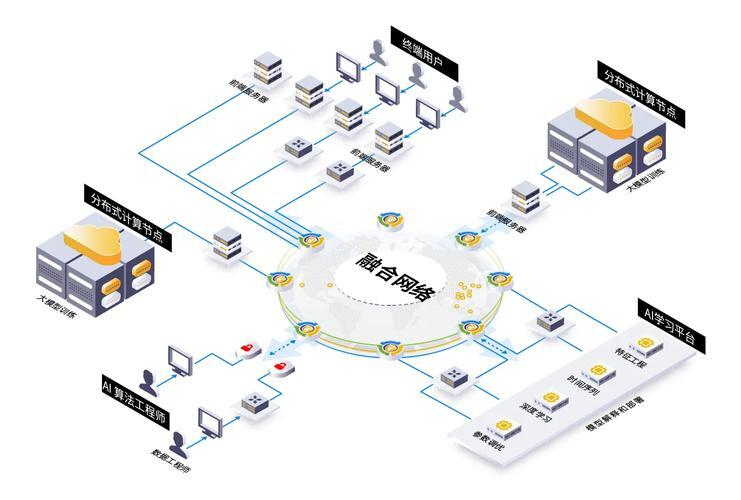

进入腾讯云大模型引擎官方网站。点击【产品体验】,即可进入体验中心,即可看到体验中心中给出的一些最佳实践。

其中

免责声明:我们致力于保护作者版权,注重分享,被刊用文章因无法核实真实出处,未能及时与作者取得联系,或有版权异议的,请联系管理员,我们会立即处理! 部分文章是来自自研大数据AI进行生成,内容摘自(百度百科,百度知道,头条百科,中国民法典,刑法,牛津词典,新华词典,汉语词典,国家院校,科普平台)等数据,内容仅供学习参考,不准确地方联系删除处理! 图片声明:本站部分配图来自人工智能系统AI生成,觅知网授权图片,PxHere摄影无版权图库和百度,360,搜狗等多加搜索引擎自动关键词搜索配图,如有侵权的图片,请第一时间联系我们。