用 Golang 构建 GPT-2 前端服务:对接 Flask API 实现跨语言调用

本文介绍如何使用 Go 语言构建一个基于 Gin 框架的前端 Web 服务,接收网页输入或 Postman 请求,并将 prompt 请求转发到 GPT-2 Flask 推理 API,适合前后端分离部署与跨语言系统集成。

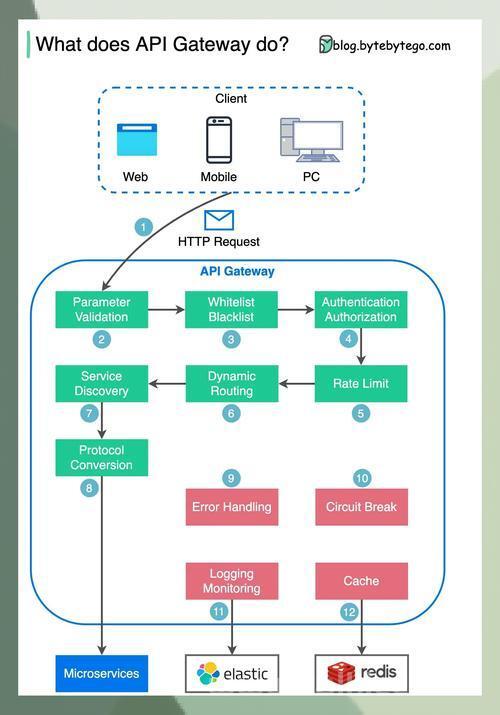

🌐 系统架构概览

本项目采用前后端分离结构:

- 前端服务:由 Golang + Gin 提供,负责网页展示和 API 中转

- 后端推理:由 Flask 封装的 TensorRT GPT-2 模型负责返回推理结果

- 通信协议:HTTP + JSON

架构示意图:

前端浏览器/Postman ↓ Gin(Golang 服务):8080 ↓ (JSON POST) Flask 服务(Python):6006 ↓ TensorRT 推理 & 返回 token

📁 目录结构

. ├── main.go # Go 主程序 ├── static/ # 静态资源目录 ├── templates/index.html # 网页模板

1️⃣ Go 中的 API 调用流程说明

文件核心为 main.go,作用如下:

- 加载网页模板与静态资源

- 接收前端的 JSON 请求(prompt)

- 将请求转发给 Flask 服务

- 将结果返回给网页 / 前端 / Postman

2️⃣ Go 核心代码结构

package main import ( "bytes" "encoding/json" "github.com/gin-gonic/gin" "io/ioutil" "net/http" "path/filepath" ) type RequestBody struct { Prompt string `json:"prompt"` } type ResponseBody struct { Response string `json:"response"` } func main() { r := gin.Default() r.LoadHTMLGlob(filepath.Join("templates", "*.html")) r.Static("/static", "./static") // 网页入口 r.GET("/", func(c *gin.Context) { c.HTML(200, "index.html", nil) }) // 推理 API:接收前端请求,转发给 Flask r.POST("/infer", func(c *gin.Context) { var req RequestBody if err := c.BindJSON(&req); err != nil { c.JSON(400, gin.H{"error": "Invalid request"}) return } // 发送 POST 请求给 Python 后端 reqJson, _ := json.Marshal(req) resp, err := http.Post("http://localhost:6006/infer", "application/json", bytes.NewBuffer(reqJson)) if err != nil { c.JSON(500, gin.H{"error": "调用 Flask 服务失败", "detail": err.Error()}) return } defer resp.Body.Close() body, _ := ioutil.ReadAll(resp.Body) var result ResponseBody if err := json.Unmarshal(body, &result); err != nil { c.JSON(500, gin.H{"error": "返回格式异常", "raw": string(body)}) return } c.JSON(200, result) }) r.Run(":8080") }3️⃣ 前端测试页面(可选)

在 templates/index.html 中写一个简单表单:

提交 document.getElementById("gpt-form").addEventListener("submit", async (e) => { e.preventDefault(); const prompt = document.getElementById("prompt").value; const res = await fetch("/infer", { method: "POST", headers: { "Content-Type": "application/json" }, body: JSON.stringify({ prompt }) }); const data = await res.json(); document.getElementById("result").innerText = data.response; });4️⃣ 测试接口(Postman 示例)

- URL:http://localhost:8080/infer

- 请求方式:POST

- 请求体:

{ "prompt": "你好,今天天气" }返回:

{ "response": "模型生成词: 很" }✅ Gin 框架特点总结

特性 描述 简洁高效 更适合构建快速 API 服务 支持模板 可集成 HTML 页面 易于维护 与 Python 后端分离,逻辑清晰 可部署 直接 go build 编译为单一二进制文件 📌 总结

- 本文讲解如何使用 Go 构建 GPT-2 的前端对接服务

- 使用 Gin 实现 API 转发,网页、Postman 都可调用

- 与 Flask+TensorRT 的后端服务无缝协作

- 为部署到线上或前后端分离奠定基础

- 对应项目 gpt2-trt-deploy 的 main.go

📎 本文为 GPT-2 部署系列第五篇

🧭 本系列 GPT-2 项目加速部署系列五部曲

- 🧩 第一篇:将 GPT-2 导出为 ONNX 模型:部署加速第一步

- 🚀 第二篇:用 TensorRT 加速 GPT-2 推理:ONNX 加载、CUDA 显存管理与性能优化实战

- 🌐 第三篇:PyTorch vs TensorRT 推理性能对比:GPT-2 加速效果实测报告

- 🧠 第四篇:用 Flask 封装 GPT-2 TensorRT 推理接口:构建可远程调用的文本生成服务

- 💼 第五篇:用 Golang 构建 GPT-2 前端服务:对接 Flask API 实现跨语言调用

📌 YoanAILab 技术导航页

💡 项目源码 × 实战部署 × 转型经验,一页总览

👉 点击查看完整导航页

📚 包含内容:

- 🧠 GPT-2 项目源码(GitHub)

- ✍️ CSDN 技术专栏合集

- 💼 知乎转型日志

- 📖 公众号 YoanAILab 全文合集

(图片来源网络,侵删)(图片来源网络,侵删)(图片来源网络,侵删)

免责声明:我们致力于保护作者版权,注重分享,被刊用文章因无法核实真实出处,未能及时与作者取得联系,或有版权异议的,请联系管理员,我们会立即处理! 部分文章是来自自研大数据AI进行生成,内容摘自(百度百科,百度知道,头条百科,中国民法典,刑法,牛津词典,新华词典,汉语词典,国家院校,科普平台)等数据,内容仅供学习参考,不准确地方联系删除处理! 图片声明:本站部分配图来自人工智能系统AI生成,觅知网授权图片,PxHere摄影无版权图库和百度,360,搜狗等多加搜索引擎自动关键词搜索配图,如有侵权的图片,请第一时间联系我们。